网站中的robots.txt协议如何使用

![]() 访客

2021-05-14 09:45:53

504

访客

2021-05-14 09:45:53

504

SEO服务人员介绍很多建站系统,在建成网站后,都网站根目录,默认有robots.txt协议文件。在网站优化竞争日益加剧的今天,原本设立之初无优化因素的robots.txt文件也被最大化使用,掌握其写法,有备无患。那么,网站中的robots.txt协议如何使用?

一:网站中的robots.txt协议如何使用?robots.txt协议文件有什么用?

搜索引擎访问一个网站的时候,最先访问的文件就是robots.txt。她告诉搜索引擎蜘蛛,哪些网站页面可以被抓取,哪些禁止抓取。表面来看,这个功能作用有限。从搜索引擎优化的角度来看,可以通过屏蔽页面,达到集中权重的作用,这,也是优化人员最为看重的地方。

二:网站设置robots.txt的几个原因。

1:设置访问权限保护网站安全。

2:禁止搜索引擎爬取无效页面,集中权值到主要页面。

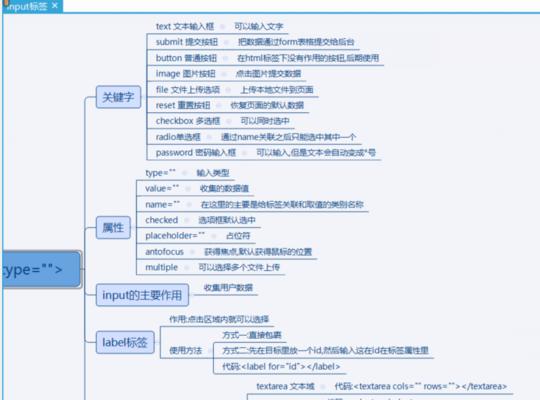

三:怎么用标准写法书写协议? 有几个概念需掌握。

User-agent表示定义哪个搜索引擎,如User-agent:Baiduspider,定义百度蜘蛛。 Disallow表示禁止访问。 Allow表示运行访问。 通过以上三个命令,可以组合多种写法,允许哪个搜索引擎访问或禁止哪个页面。

四:robots.txt文件放在那里?

此文件需放置在网站的根目录,且对字母大小有限制,文件名必须为小写字母。所有的命令第一个字母需大写,其余的小写。且命令之后要有一个英文字符空格。

五:网站中的robots.txt协议如何使用?哪些时候需要使用该协议?

1:无用页面,很多网站都有联系我们,用户协议等页面,这些页面相对于搜索引擎优化来讲,作用不大,此时需要使用Disallow命令禁止这些页面被搜索引擎抓取。

2:动态页面,企业类型站点屏蔽动态页面,有利于网站安全。且多个网址访问同一页面,会造成权重分散。因此,一般情况下,屏蔽动态页面,保留静态或伪静态页面。

3:网站后台页面,网站后台也可以归类于无用页面,禁止收录有百益而无一害。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 3561739510@qq.com 举报,一经查实,本站将立刻删除。

转载请注明来自专注SEO技术,教程,推广 - 8848SEO,本文标题:《网站中的robots.txt协议如何使用》

标签:

- 上一篇: 宁波SEO服务正规SEO优化公司有哪些优势

- 下一篇: 想要做好网站SEO推广需要掌握什么技巧?

- 搜索

- 最新文章

-

- 看了红米K90的爆料,感觉K80至尊版不香了?新机或有三大优势加持小结

- 还是最强大杯?vivo X300 Pro曝光,感觉X200 Pro彻底不香了小结

- 双2亿镜头?Find X9系列曝光

- iOS 26 beta 3 新功能一览:壁纸颜色选项、更强大的模糊效果等

- 华为Mate80曝光:屏幕和影像进一步确认,或11月正式发布!

- 热血传奇新百区:斧头,魔力,珊瑚,看似简陋实则为运10套大战

- 织梦网站的关键词怎么放?如何优化关键词提高SEO效果?

- 网站如何推广文案高级?高级文案推广策略有哪些?

- 如何自制网站推广软件?自制软件与购买服务哪个更划算?

- S40发育路救星出现了三位:沸腾流蒙犽、法球流戈娅强烈推荐!

- 热门文章

-

- 全新战力系统来袭,排位或成单排玩家噩梦,百段分路人人皆有可能

- vivo X300Pro曝光:天玑9500+大直屏+2亿潜望,或9月发布!

- 华为Mate 80系列将带来定制OLED显示技术,这项技术具备三大优势

- 抖音中怎么开始剪辑作品?新手入门剪辑流程是什么?

- 产品如何在淘宝推广网站?有哪些有效的推广策略?

- 如何算卦网站推广赚钱多?有哪些有效策略可以提高收益?

- 抖音视频拍摄与剪辑技巧?如何制作火爆内容?

- 小吃店抖音视频剪辑技巧有哪些?如何快速上手?

- 华为重磅双旗舰曝光:三折叠MateXT2或9月发布

- 原神:10抽奖励记得领!伊涅芙v3改动!6.0新角色剪影!UGC界面!

- 高温红色警报!电动车夏季充电紧急提醒,牢记“3要拔4不充”要求

- 巨大升级?苹果电池干到5000mAh了,续航反杀安卓,库克终于开窍了?

- 70%的免伤,48%的吸血,孙权成为S40发育路玩家救星!附玩法思路

- iQOO15细节曝光:2K大直屏+3D超声波+7K新电池,或10月发布

- 抖音小说视频剪辑技巧有哪些?如何快速制作?

- 抖音视频编辑技巧:如何剪辑掉不美好的部分?

- 抖音漫画视频剪辑技巧有哪些?如何制作高质量内容?

- 抖音自带的剪辑功能如何剪辑片段?操作步骤是什么?

- 怎么拍小红书视频剪辑?视频编辑有哪些技巧?

- 王者S40法师玩家遭到重创,貂蝉成首个受害对象,妲己小乔无一幸免

- 热门tag